Accaparant toutes les discussions, monopolisant la parole, l’IA semble depuis 2023 tout balayer sur son passage tel un raz de marée.

Si les questions se multiplient, les réponses demeurent en revanche parcimonieuses. Devenu une priorité pour les entreprises qui y voient, sans doute à juste titre, un tournant incontournable, le développement et l’exploitation de ces outils exigent toutefois la mise en place d’un cadre de gouvernance où les réponses à ces multiples questions sont nécessaires.

A. Réglementation européenne sur l’intelligence artificielle

Dans les semaines à venir, je me propose de faire un tour de celui qui, de « Proposition », est en passe de devenir le Règlement européen sur l’IA, désormais connu depuis sa « fuite » du 22 janvier 2024.

En en reprenant la structure, et à raison d’une publication par semaine, nous couvrirons ainsi tour à tour : (1) les dispositions générales ; (2) les systèmes d’IA à usage général ; (3) les pratiques interdites ; (4) celles à haut-risque ; (5) les obligations de transparence ; (6) les mesures mises en place pour encourage l’innovation ; (7) la gouvernance ; (8) le registre ; (9) les obligations de veille et de surveillance ; (10) les codes de conduite ; (11) les sanctions pour terminer par (12) les enjeux relatifs à la délégation des pouvoirs.

En attendant que l’examen de cette Réglementation ne commence à compter de la semaine prochaine, intéressons-nous cette semaine à un état de la situation autour des enjeux posés par ces systèmes en matière de droits d’auteur à l’aune des affaires juridiques en cours.

B. L’affaire NY Times contre OpenAI et Microsoft

Dernière en date, l’action intentée le 27 décembre 2023 devant la United States District Court Southern District of New York par le NY Times non seulement contre OpenAI, mais également contre Microsoft, est sans doute la plus emblématique puisque, pour la première fois, un acteur majeur saisit un Tribunal.

A l’image de nombreuses autres actions en cours, le NY Times y invoque une violation massive de ses droits ; fort d’une demande de 69 pages, le NY Times y démontre au travers moults exemples que les résultats générés par ChatGPT aboutissent en de nombreuses hypothèses sur la base de prompts des plus simples à une reprise en réalité quasi-intégrale de certains articles publiés.

Dans cette affaire, ce ne sont donc plus seulement les données d’entraînement (input) qui sont en cause, affaires dans lesquelles la problématique du fair use se pose aux Etats-Unis avec une indéniable acuïté, mais bien le résultat lui-même (output).

Or, s’agissant du résultat (output), force est d’admettre que l’exception tirée du fair use apparaît beaucoup moins convaincante, à tout le moins dans cette affaire. Le NY Times démontre avec moults exemples qu’en de nombreux cas, ces résultats reprennent en large partie ses articles.

Pour le NY Times, le risque est alors grand de voir les internautes renoncer à s’abonner au quotidien, des abonnements ô combien précieux comme le souligne le NY Times pour assurer le maintien de la qualité journalistique à une époque où la désinformation est devenue légion. Si elle intéresse en première ligne le NY Times, c’est donc bien le monde de la presse dans son ensemble qui voit son avenir en jeu dans le cadre de cette affaire.

De prime abord, on voit difficilement comment les conditions posées à l’exercice du fair use pourraient être réunies, et comment, à l’aune de la demande, et à ce stade du moins, les parties défenderesses pourraient échapper à une reconnaissance de la violation par leurs soins des droits d’auteur du NY Times.

Le 8 janvier 2024, OpenAI s’est fendue d’une longue lettre rejetant les allégations jugées fallacieuses de OpenAI. Sans surprise, elle y rappelle que nonobstant la faculté pour les auteurs de faire du « opt out », l’entraînement de données protégées est un cas de fair use. Elle ajoute que les exemples cités dans la demande ne constituent en réalité que des cas rarissimes reflétant des prompts présentant une volonté délibérée de manipuler le système. Affaire à suivre.

C. Affaires en cours

Depuis l’année dernière, les affaires ayant trait aux enjeux en matière de droits d’auteur sont nombreuses, qu’elles aient trait aux questions entourant les données d’entraînement (input) ou, dans une moindre mesure, le résultat (output).

(I) Violation des droits d’auteur sur des données d’entraînement (input) ?

En ce qui a trait aux affaires ayant essentiellement trait aux données d’entraînement, on peut mentionner sans prétendre à l’exhaustivité, aux Etats-Unis :

En dehors des Etats-Unis, on peut également mentionner :

(II) Droits d’auteur sur les résultats générés (output) ?

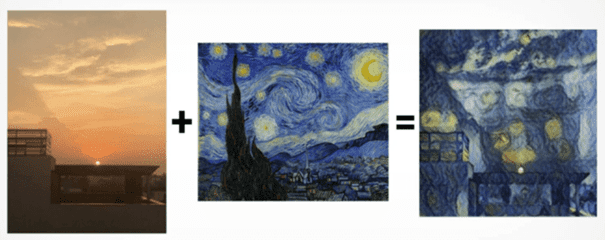

Ainsi en a-t-il été s’agissant des bureaux de propriété intellectuelle tant en Inde qu’au Canada, où ces bureaux ont accepté d’enregistrer l’œuvre intitulée Suryast de l’artiste Sahni susmentionnée. Il en a été de même en Corée du Sud où la compagnie Nara Knowledge Information a obtenu l’enregistrement de son film « AI Suro’s Wife » pour lequel elle avait recouru aux outils Midjourney et Stable Diffusion, l’office coréen ayant là aussi considéré que la sélection et l’arrangement des images dans le cadre des travaux d’édition du film témoignait d’un apport humain individuel suffisant.

Ainsi en a-t-il enfin été sur le plan judiciaire cette fois-ci tant en Chine, où le Beijing Internet Court a admis le 27 novembre 2023 une action en violation des droits d’auteur intentée sur la base d’une œuvre générée au moyen de Stability Diffusion, reconnaissant que l’enchaînement des prompts et l’œuvre en résultant témoignait d’un travail exigeant de sélectionner et d’arranger rigoureusement tant les prompts que les résultats générés au fil de ces prompts :

D. Conclusion

Que peut-on conclure de ce survol de la situation en ce début d’année 2024 ?

(I) Données d’entraînement

On peut s’étonner du fait que OpenAI s’offusque des reproches qui lui sont formulés alors qu’elle recherche à l’évidence des partenariats avec des acteurs majeurs susceptibles de lui fournir un flux massif de données.

Ainsi, en juillet 2023, elle signait tant avec Associated Press qu’avec Shutterstock un contrat de licence lui permettant d’exploiter leurs contenus. Le 13 décembre 2023, elle faisait de même avec le géant de l’édition Axel Springer (dont on peut se demander si elle ne se tire pas une balle dans le pied, même si les clauses de la transaction nous sont évidemment inconnues).

En toute hypothèse, on peine à voir ce qui pousserait OpenAI à signer de tels accords si elle ne reconnaissait pas le caractère illicite des reproductions qu’elle opère en reproduisant ces données pour entraîner son modèle.

Toujours est-il que les affaires actuellement en cours témoignent d’ores et déjà des difficultés procédurales que les parties demanderesses à de telles actions sont susceptibles de rencontrer pour gagner en justice.

Le débat ne se limite pas à la seule question de savoir si ces données d’entraînement violent les droits des titulaires et si les développeurs de ces outils génératifs peuvent se prévaloir d’une exception. Encore faut-il tout d’abord que le tribunal saisi soit compétent pour ce faire. Or, si la plupart des affaires ont été introduites aux Etats-Unis, siège des développeurs où la question de la compétence ne se pose pas, la question est autre lorsque les titulaires souhaitent agir à l’étranger. L’affaire Getty Images pendante devant la High Court of Justice of London souligne le fait que la compétence de cette Cour est une question ouverte, sur laquelle la High Court devra se prononcer. Peu examinés à ce jour, les aspects de droit international privé ne sauraient être sous-estimer.

Ensuite, à supposer le Tribunal compétent, encore faut-il que les parties demanderesses aient la légitimation active, soit qu’elles démontrent le fait que des œuvres sur lesquelles elles détiennent des droits ont été concrètement reproduites pour servir de données d’entraînement ; une simple allégation suivant laquelle une telle exploitation apparaît plus que probable au vu du nombre d’images reproduites ne semble pas suffire. La barre pourrait donc s’avérer particulièrement haute.

Gageons que des solutions se mettront en place dans les années à venir, par exemple sous forme de droit à rémunération ou de licence collective étendue, sans forcément aller jusqu’à offrir un blanc-seing pour de tels entraînement comme ont choisi de le faire le Japon, Singapoure ou encore possiblement Israel.

(II) Résultats générés

Si l’Ukraine a opté en 2023 pour l’introduction d’un droit sui generis protégeant les résultats générés par les outils génératifs, ce choix semble demeurer une exception. Apparaît plus généralement décisive la question de savoir si l’utilisateur a fourni une contribution suffisante dans l’enchaînement des prompts et leur arrangement pour pouvoir être considéré comme « auteur ».

Si ce critère semble s’imposer, force est d’admettre que son interprétation varie grandement d’un Etat à l’autre :

Les Etats-Unis placent pour le moment la barre particulièrement haut ; si 80 heures de travail et des milliers de prompts n’ont pas suffi à convaincre le USCO que la contribution de Jason Michael Allen était suffisante qu’il soit considéré comme l’auteur de Théâtre d’Opéra Spatial, on peut se demander quel est le niveau attendu par le USCO.

A l’inverse, la Chine semble généreuse en ayant admis qu’était protégée par des droits d’auteur une image de jeune femme dont on peut se demander si elle présente véritablement une « originalité » suffisante au sens où l’exige en principe le droit d’auteur.

Tout dépend donc du niveau où l’on entend placer le curseur pour reconnaître un caractère causal suffisant entre l’utilisateur et le résultat généré pour voir dans le premier l’auteur du second.

La question, fondamentale, de savoir si de tels résultats méritent d’être protégés compte tenu de la raison d’être du droit d’auteur, soit inciter à la création, devrait également être posée. Devrais-je me voir reconnaître l’octroi de tels droits sur un résultat « artistique » en dépit du fait que je ne dispose en réalité d’aucune compétence pour ce faire et que mes seules qualités résideraient dans la capacité à faire du prompting efficace ?

Le prompting pourrait-il être considéré comme l’équivalent du pinceau comme l’invoquait Jason Michael Allen, un argument que le USCO a refusé d’entendre. Ne serait-ce cependant pas prendre le risque de niveler le niveau du droit d’auteur vers le bas, en conférant de tels droits à une très grande majorité d’utilisateurs ? Plus encore, cela ne reviendrait-il pas à niveler le niveau exigé de créativité en octroyant au final des droits d’auteur sur des millions d’œuvres générées chaque jour ? A quel niveau faut-il placer la barre ? Autant de questions qui méritent d’être posées et qui, pour le moment, n’ont pas encore trouvé de réponses définitives (pour un échange sur ces questions, voir l’intéressante contribution de Damian Flisak).

Vous avez des questions par rapport à la problématique abordée dans cet article ?

Nos avocats aiment et comprennent le droit des affaires, sur le plan suisse et sur le plan international. Ils sont très réactifs et portent les affaires de leurs clients aux fins d’y trouver la meilleure solution juridique et pratique. Ils sont au bénéfice d’une expérience internationale de plusieurs années en droit des affaires. Ils maîtrisent plusieurs langues étrangères et disposent de correspondants dans le monde entier.

Avenue de Rumine 13

Case Postale

CH – 1001 Lausanne

+41 21 711 71 00

info@wg-avocats.ch

©2024 Wilhelm Avocats SA – Politique en matière de confidentialité – Réalisation Mediago